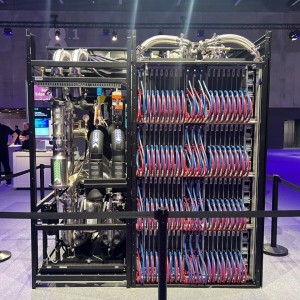

L'UEC va travailler sur la couche physique, la liaison, le transport et le logiciel de l’Ethernet afin de faire évoluer la norme. (Crédit S.L.)

Mené par Arista, Cisco, HPE, Intel, et soutenu par la Fondation Linux, l'Ultra Ethernet Consortium veut accroître l'échelle, la stabilité et la fiabilité des réseaux Ethernet afin de répondre aux exigences de l'IA en matičre de réseaux ŕ haute performance.

C'est pour répondre aux exigences de performance et de capacité sans précédent que devraient imposer les charges de travail IA aux réseaux que des fournisseurs de réseaux se sont associés pour améliorer la technologie Ethernet actuelle et mieux gérer l'échelle et la vitesse requises par l'IA. AMD, Arista, Broadcom, Cisco, Eviden, HPE, Intel, Meta et Microsoft ont ainsi annoncé la création de l'Ultra Ethernet Consortium (UEC). Hébergé par la Fondation Linux, le groupe va travailler sur la couche physique, la liaison, le transport et le logiciel de l'Ethernet afin de faire évoluer la norme qui a célébré son 50e anniversaire. Caractérisée par sa flexibilité et son adaptabilité, la vénérable technologie devrait jouer un rôle essentiel dans la prise en charge des infrastructures d'intelligence artificielle. Cependant, certains craignent que les interconnexions de réseau traditionnelles actuelles ne puissent fournir les performances, l'échelle et la bande passante nécessaires pour répondre aux exigences de l'IA, et le consortium s'est donné pour objectif de répondre ŕ ces préoccupations. « Les charges de travail de l'IA sont exigeantes pour les réseaux, car elles sont ŕ la fois gourmandes en données et en calculs. Elles sont si importantes que les paramčtres sont répartis sur des milliers de processeurs. Les grands modčles de langage (LLM) comme GPT-3, Chinchilla et PALM, de męme que les systčmes de recommandation comme DLRM (Deep Learning Recommendation) et DHEN (Deep and Hierarchical Ensemble Network) sont entrainés sur des clusters de plusieurs milliers de GPU qui partagent les « paramčtres » avec d'autres processeurs impliqués dans le calcul », a écrit Jayshree Ullal, le CEO d'Arista, dans un blog sur le consortium. « Dans ce cycle de calcul, d'échange et de réduction, le volume de données échangées est si important que tout ralentissement dű ŕ un réseau de mauvaise qualité ou encombré peut avoir un impact critique sur les performances de l'application d'intelligence artificielle », a-t-il ajouté.

Historiquement, les interconnexions comme InfiniBand, PCI Express, Remote Direct Memory Access over Ethernet (RDMA) et d'autres protocoles qui connectent les clusters de calcul avec des déchargements, sont les seules options disponibles pour connecter les coeurs de processeurs et la mémoire. Mais elles sont insuffisantes pour répondre aux exigences des charges de travail de l'IA. « Arista et les membres fondateurs de l'Ultra Ethernet Consortium pensent qu'il est temps de reconsidérer et de remplacer les limitations RDMA. La technologie RDMA traditionnelle, telle que définie il y a plusieurs dizaines d'années par l'InfiniBand Trade Association (IBTA), a atteint ses limites quand le trafic réseau comme celui de l'AI/ML devient trčs exigeant. Le RDMA transmet les données par portions de flux importants, et ces flux importants peuvent déséquilibrer et surcharger les liens », a encore écrit M. Ullal. « Il est temps de faire table rase du passé pour construire un protocole de transport moderne prenant en charge le RDMA pour les applications émergentes », a ajouté le CEO d'Arista. « Le protocole UET (Ultra Ethernet Transport) du Consortium intégrera les avantages de l'Ethernet/IP tout en prenant en compte l'échelle du réseau AI pour les applications, les points terminaux et les processus, tout en préservant l'objectif de normes ouvertes et d'interopérabilité multi-fournisseurs ».

Les évolutions attendues

Dans un livre blanc, l'UEC indique qu'elle fera évoluer la spécification Ethernet pour qu'elle intčgre un certain nombre de technologies et de capacités fondamentales, notamment :

- Le multi-pathing et la pulvérisation de paquets - ou packet spraying - pour s'assurer que les workflows de l'intelligence artificielle ont accčs ŕ une destination simultanément.

- Un ordre de livraison flexible pour s'assurer que les liens Ethernet sont équilibrés de maničre optimale ; l'ordre n'est appliqué que lorsque la charge de travail de l'IA l'exige dans le cadre d'opérations ŕ forte consommation de bande passante.

- Des mécanismes modernes de contrôle de la congestion pour s'assurer que les charges de travail d'IA évitent les points chauds et répartissent uniformément la charge sur les trajets multiples. Ils peuvent ętre conçus pour fonctionner en conjonction avec la pulvérisation de paquets par trajets multiples, ce qui permet un transport fiable du trafic d'IA.

- Une télémétrie de bout en bout pour gérer la congestion. Les informations provenant du réseau peuvent informer les participants sur la localisation et la cause de la congestion. Un chemin plus court pour informer sur la congestion et la remontée de plus d'informations aux points d'extrémité offrent un contrôle plus réactif de la congestion.

Un protocole UEC ŕ venir

L'Ultra Ethernet Consortium affirme qu'il augmentera l'échelle, la stabilité et la fiabilité des réseaux Ethernet, tout en améliorant la sécurité. « Le transport UEC intčgre la sécurité du réseau dčs la conception et peut crypter et authentifier tout le trafic réseau envoyé entre les points de traitement dans le cadre d'un travail d'apprentissage ou d'inférence de l'IA. L'UEC développera un protocole de transport qui s'appuie sur les techniques éprouvées de gestion efficace des sessions, l'authentification et la confidentialité des méthodes de cryptage modernes comme IPSec et PSP », a écrit l'UEC. « Le volume des tâches étant toujours plus important, il est nécessaire de réaliser le cryptage sans surcharger la session au niveau des hôtes et des interfaces réseau. Pour ce faire, le protocole Ultra Ethernet Transport intčgre de nouveaux mécanismes de gestion des clés qui permettent un partage efficace des clés entre des dizaines de milliers de noeuds de calcul participant ŕ une tâche. Il est conçu pour ętre mis en oeuvre efficacement aux vitesses et échelles élevées requises par l'apprentissage et l'inférence de l'IA », a déclaré le Consortium. « Il ne s'agit pas de réviser Ethernet », a déclaré par ailleurs le Dr. J. Metz, président de l'Ultra Ethernet Consortium, dans un communiqué. « Il s'agit de régler l'Ethernet pour améliorer l'efficacité des charges de travail ayant des exigences spécifiques en matičre de performances. Nous examinons chaque couche - de la couche physique ŕ la couche logicielle - pour trouver le meilleur moyen d'améliorer l'efficacité et la performance ŕ l'échelle », a ajouté le M. Metz

La nécessité d'améliorer la technologie de connectivité de l'IA commence ŕ se faire sentir. Par exemple, dans son dernier rapport intitulé « Data Center 5-Year July 2023 Forecast Report », le Dell'Oro Group a déclaré que d'ici ŕ 2027, 20 % des ports de commutation Ethernet des datacenters seront connectés ŕ des serveurs accélérés pour prendre en charge les charges de travail d'IA. « L'essor de nouvelles applications d'IA générative contribuera ŕ davantage alimenter un marché des commutateurs de datacenter déjŕ robuste, qui devrait dépasser 100 milliards de dollars de ventes cumulées au cours des cinq prochaines années », a déclaré Sameh Boujelbene, vice-président de Dell'Oro. Dans un autre rapport publié récemment, le 650 Group a déclaré que l'IA/ML imposait au réseau des exigences considérables en matičre de performance de la bande passante, et que l'IA/ML était l'un des principaux moteurs de croissance pour la commutation des datacenters au cours des cinq prochaines années. « Avec l'augmentation de la bande passante en IA, la part de la commutation Ethernet liée ŕ l'IA/ML et au traitement accéléré passera, d'ici ŕ 2027, d'un marché de niche, ce qu'il est aujourd'hui, ŕ une part significative du marché. « Les livraisons de commutateurs et d'optiques ŕ 800 Gbps devraient atteindre des niveaux record dčs que les produits pourront ętre mis en production pour répondre aux besoins de l'IA/ML », a déclaré Alan Weckel, fondateur et analyste technologique du 650 Group.

Suivez-nous